ケーススタディ -

これはケーススタディです。ケーススタディは個別に時間が設定されるわけではありません。各ケースを完了したいだけ試験時間を費やすことができます。ただし、この試験には追加のケーススタディやセクションが存在する場合があります。この試験に含まれるすべての質問を指定された時間内に完了できるように時間を管理する必要があります。

ケーススタディに含まれる質問に答えるには、ケーススタディで提供される情報を参照する必要があります。ケース スタディには、ケース スタディで説明されているシナリオに関する詳細情報を提供する展示やその他のリソースが含まれる場合があります。このケーススタディでは、各質問は他の質問から独立しています。

このケーススタディの最後に、レビュー画面が表示されます。この画面では、試験の次のセクションに進む前に、回答を確認し、変更を加えることができます。新しいセクションを開始した後は、このセクションに戻ることはできません。

ケーススタディを開始するには -

このケーススタディの最初の質問を表示するには、「次へ」ボタンをクリックします。質問に答える前に、左側のペインのボタンを使用してケーススタディの内容を調べてください。これらのボタンをクリックすると、ビジネス要件、既存の環境、問題の説明などの情報が表示されます。ケーススタディに [すべての情報] タブがある場合、表示される情報は後続のタブに表示される情報と同じであることに注意してください。質問に答える準備ができたら、「質問」ボタンをクリックして質問に戻ります。

会社概要 -

HipLocal は、近くにいる人々の間のコミュニケーションを促進するように設計されたコミュニティ アプリケーションです。スポーツイベントの企画や開催、企業が地域社会とつながるために利用されています。 HipLocal は最近ダラスのいくつかの地域でサービスを開始し、急速に世界的な現象に成長しています。ハイパーローカルなコミュニティコミュニケーションとビジネスアウトリーチのユニークなスタイルは、世界中で需要があります。

エグゼクティブステートメント -

私たちはナンバーワンのローカルコミュニティアプリです。地域コミュニティ サービスをグローバルに展開する時が来ました。私たちのベンチャー キャピタルの投資家は、メンバーが互いに 10 マイルまたは 10,000 マイル離れていても、急速な成長と、オンラインに登場する新しいローカル コミュニティや仮想コミュニティに同様の素晴らしい体験を提供したいと考えています。

ソリューションコンセプト -

HipLocal は、世界中の顧客により良いサービスを提供するために、最新の機能を備えた既存のサービスを新しい地域で拡張したいと考えています。彼らは、これらの地域をタイムゾーンでサポートするための新しいチームを雇用してトレーニングしたいと考えています。アプリケーションがスムーズに拡張され、明確な稼働時間データが提供されることを確認し、発生した問題を分析して対応する必要があります。

既存の技術環境 -

HipLocal の環境は、オンプレミスのハードウェアと Google Cloud Platform で実行されるインフラストラクチャが混在しています。 HipLocal チームはアプリケーションをよく理解していますが、世界規模のアプリケーションの経験は限られています。現在の技術環境は次のとおりです。

• 既存の API は、GCP でホストされている Compute Engine 仮想マシン インスタンス上で実行されます。

• 状態は、GCP の単一インスタンスの MySQL データベースに保存されます。

• リリース サイクルには、QA テストを可能にする開発の凍結が含まれます。

• アプリケーションにはログが記録されません。

• アプリケーションは、平日の夕方のトラフィックが少ない時間帯に、インフラストラクチャ エンジニアによって手動で展開されます。

• 稼働時間の基本的な指標があります。 API が応答しない場合、アラートが頻繁に発生します。

ビジネス要件 -

HipLocal の投資家は、その拠点を拡大し、見られる需要の増加をサポートしたいと考えています。彼らの要件は次のとおりです。

• アプリケーションの利用可能性を新しい地域に拡大します。

• 10 倍の同時ユーザーをサポートします。

• ユーザーが異なる地域に旅行する場合でも、一貫したエクスペリエンスを確保します。

• ユーザーアクティビティの指標を取得して、製品を収益化する方法をより深く理解します。

• 新しい地域の規制 (GDPR など) への準拠を確保します。

• インフラストラクチャ管理の時間とコストを削減します。

• Google が推奨するクラウド コンピューティングのプラクティスを採用します。

○ アプリケーションのライフサイクル管理に関する標準化されたワークフローとプロセスを開発します。

○ サービス レベル指標 (SLI) とサービス レベル目標 (SLO) を定義します。

技術的要件 -

• オンプレミスのデータセンターとクラウドでホストされているアプリケーションおよびインフラストラクチャの間で安全な通信を提供します。

• アプリケーションは使用状況のメトリクスと監視を提供する必要があります。

• API には認証と認可が必要です。

• 新しい機能のより迅速かつ正確な検証を実装します。

• ロギングとパフォーマンスのメトリクスは、デバッグ情報とアラートを提供できるように実用的な情報を提供する必要があります。

• ユーザーの需要に合わせて拡張する必要があります。

この質問については、HipLocal のケーススタディを参照してください。

HipLocal は、ユーザーの大幅な増加に対応できるようにアプリケーションを拡張するには、アーキテクチャをどのように再設計すればよいでしょうか?

-

A.

Google Kubernetes Engine (GKE) を使用して、アプリケーションをマイクロサービスとして実行します。 MySQL データベースを専用の GKE ノードで実行します。

-

B.

複数の Compute Engine インスタンスを使用して MySQL を実行し、状態情報を保存します。 Google Cloud が管理するロードバランサを使用して、インスタンス間の負荷を分散します。スケーリングにはマネージド インスタンス グループを使用します。

-

C.

Memorystore を使用してセッション情報を保存し、CloudSQL を使用して状態情報を保存します。 Google Cloud が管理するロードバランサを使用して、インスタンス間の負荷を分散します。スケーリングにはマネージド インスタンス グループを使用します。

-

D.

Cloud Storage バケットを使用してアプリケーションを静的ウェブサイトとして提供し、別の Cloud Storage バケットを使用してユーザー状態情報を保存します。

Case study -

This is a case study. Case studies are not timed separately. You can use as much exam time as you would like to complete each case. However, there may be additional case studies and sections on this exam. You must manage your time to ensure that you are able to complete all questions included on this exam in the time provided.

To answer the questions included in a case study, you will need to reference information that is provided in the case study. Case studies might contain exhibits and other resources that provide more information about the scenario that is described in the case study. Each question is independent of the other questions in this case study.

At the end of this case study, a review screen will appear. This screen allows you to review your answers and to make changes before you move to the next section of the exam. After you begin a new section, you cannot return to this section.

To start the case study -

To display the first question in this case study, click the Next button. Use the buttons in the left pane to explore the content of the case study before you answer the questions. Clicking these buttons displays information such as business requirements, existing environment, and problem statements. If the case study has an All Information tab, note that the information displayed is identical to the information displayed on the subsequent tabs. When you are ready to answer a question, click the Question button to return to the question.

Company Overview -

HipLocal is a community application designed to facilitate communication between people in close proximity. It is used for event planning and organizing sporting events, and for businesses to connect with their local communities. HipLocal launched recently in a few neighborhoods in Dallas and is rapidly growing into a global phenomenon. Its unique style of hyper-local community communication and business outreach is in demand around the world.

Executive Statement -

We are the number one local community app; it's time to take our local community services global. Our venture capital investors want to see rapid growth and the same great experience for new local and virtual communities that come online, whether their members are 10 or 10000 miles away from each other.

Solution Concept -

HipLocal wants to expand their existing service, with updated functionality, in new regions to better serve their global customers. They want to hire and train a new team to support these regions in their time zones. They will need to ensure that the application scales smoothly and provides clear uptime data, and that they analyze and respond to any issues that occur.

Existing Technical Environment -

HipLocal's environment is a mix of on-premises hardware and infrastructure running in Google Cloud Platform. The HipLocal team understands their application well, but has limited experience in global scale applications. Their existing technical environment is as follows:

• Existing APIs run on Compute Engine virtual machine instances hosted in GCP.

• State is stored in a single instance MySQL database in GCP.

• Release cycles include development freezes to allow for QA testing.

• The application has no logging.

• Applications are manually deployed by infrastructure engineers during periods of slow traffic on weekday evenings.

• There are basic indicators of uptime; alerts are frequently fired when the APIs are unresponsive.

Business Requirements -

HipLocal's investors want to expand their footprint and support the increase in demand they are seeing. Their requirements are:

• Expand availability of the application to new regions.

• Support 10x as many concurrent users.

• Ensure a consistent experience for users when they travel to different regions.

• Obtain user activity metrics to better understand how to monetize their product.

• Ensure compliance with regulations in the new regions (for example, GDPR).

• Reduce infrastructure management time and cost.

• Adopt the Google-recommended practices for cloud computing.

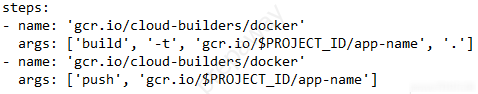

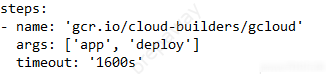

○ Develop standardized workflows and processes around application lifecycle management.

○ Define service level indicators (SLIs) and service level objectives (SLOs).

Technical Requirements -

• Provide secure communications between the on-premises data center and cloud-hosted applications and infrastructure.

• The application must provide usage metrics and monitoring.

• APIs require authentication and authorization.

• Implement faster and more accurate validation of new features.

• Logging and performance metrics must provide actionable information to be able to provide debugging information and alerts.

• Must scale to meet user demand.

For this question, refer to the HipLocal case study.

How should HipLocal redesign their architecture to ensure that the application scales to support a large increase in users?

-

A.

Use Google Kubernetes Engine (GKE) to run the application as a microservice. Run the MySQL database on a dedicated GKE node.

-

B.

Use multiple Compute Engine instances to run MySQL to store state information. Use a Google Cloud-managed load balancer to distribute the load between instances. Use managed instance groups for scaling.

-

C.

Use Memorystore to store session information and CloudSQL to store state information. Use a Google Cloud-managed load balancer to distribute the load between instances. Use managed instance groups for scaling.

-

D.

Use a Cloud Storage bucket to serve the application as a static website, and use another Cloud Storage bucket to store user state information.

コメント 1Comment 1

C

このタスクは、古いソフトウェアを削除する必要があることを示しているわけではありません。問題となるのは、時間が重要な問題の場合にのみ遅いことです。したがって、タイムクリティカルなアラートには Stackdriver を使用し、ログやそのビジネスケースのさらなる分析や保存には引き続き古いプラットフォームを利用します。

C

The task does not indicate that we should get rid of the old software. The pain point is slowness for time critical problems only. Thus we would use Stackdriver for the time critical alerts and still utilize the old platform for further analysis/storing of logs or whatever its business case is.

コメント 2Comment 2

B と D は直接省略できます。

B. Stackdriver をインストールするだけでは何も役に立ちません。通知システムが必要です

D. ここではテストは関係ありません。

A&C に基づいて、私は C を選択します

we can directly omit B and D.

B. Just installing Stackdriver wont do any good. we need notification system

D. Testing is irrelevant here.

based on A&C, i would go with C

コメント 3Comment 3

差し迫った問題に対処します:

* 重大な通知速度の問題を解決します

* 既存の監視インフラストラクチャを維持します

* 両方のシステムの長所を活用するハイブリッド アプローチを提供します

このアプローチの利点:

* Stackdriver のリアルタイム アラート機能を使用します

* 既存の監視プラットフォームへの投資を維持

* 現在の業務への中断を最小限に抑えます

* 必要に応じて段階的な移行が可能

Addresses Immediate Problem:

* Solves the critical notification speed issue

* Maintains existing monitoring infrastructure

* Provides a hybrid approach that leverages the best of both systems

Benefits of this approach:

* Uses Stackdriver's real-time alerting capabilities

* Preserves investment in existing monitoring platform

* Minimizes disruption to current operations

* Allows for gradual transition if needed

コメント 4Comment 4

最もバランスが取れており、混乱が最も少ないアプローチは、オプション C の「Stackdriver を使用してログを取得し、アラートを出し、既存のプラットフォームに送信する」ことになるでしょう。この方法により、システムを全面的に見直しなくても、Stackdriver のリアルタイム アラート機能を既存のモニタリング ワークフローにシームレスに統合できます。

the most balanced and least disruptive approach would likely be option C, "Use Stackdriver to capture and alert on logs, then ship them to your existing platform". This method allows for a seamless integration of Stackdriver's real-time alerting capabilities into your existing monitoring workflow without the need for a complete overhaul of your system.

コメント 5Comment 5

Bが正解です

B is correct answer

コメント 6Comment 6

オプション C.

オンプレミス監視システムからの通知が遅すぎ、アプリケーションは現在 GCP にあります => Stackdriver のログでアラートが表示されます。

アプリが GCE、GKE、App Engine、または Cloud Run に移行されたかどうかについては言及されていないため、「Compute Engine インスタンス」は仮定に基づいています。

Option C.

Notifications from on-prem monitoring system are too slow & applications are in GCP now => Stackdriver alerts on logs.

There's no mentioning whether the apps have been migrated to GCE, GKE, App Engine or Cloud Run, so "Compute Engine instances" come from an assumption.

コメント 7Comment 7

私ならCと一緒に行きます。

I would go with C.

コメント 8Comment 8

オプション B「コンピューティング インスタンスにスタック ドライバー エージェントをインストールする」が正解です。

Stackdriver を使用して既存のプラットフォームに配布すると、多少の遅れが生じます

Option B , Install stack driver agents on the compute instances is the correct answer .

using stackdriver and shipping it to existing platform will have some delay

コメント 9Comment 9

C

通知に問題があります。

C オプションを使用すると、Stackdriver を使用して、このすべてのデータをオンプレミス監視プラットフォームに送信した後すぐにアラートを送信できます。

C

you have problems with notifications.

C option allows you to use stackdriver to send alerts immediately and straight away after sends all this data to your on-prem monitoring platform

コメント 10Comment 10

B が正解です。

https://cloud.google.com/monitoring/agent/monitoring/installation

B is the correct answer.

https://cloud.google.com/monitoring/agent/monitoring/installation

コメント 11Comment 11

よく考えてください。あなたは、Splunk などの高価な監視システムを使用していて、インシデントから通知までの許容できない遅延時間の問題を抱えています。この問題を解決する必要があるのは、革命 (監視システムの変更) を行うことではありません。必要に応じてログがクラウド ロギングに保存されるため、すぐに使用できるアラート システムを備えた GCP モニタリングを大きな労力なしで活用できます。アラートを実装し、ログを Splunk にプッシュするだけです。シンプルズ。

Think twice. You have working an expensive monitoring system i.e Splunk and you have the problem with unacceptable delay time between incident and notification. You need to fix this problem, not doing a revolution (changing monitoring system). You can leverage GCP Monitoring with alerting system which is out-of-the-box with no huge effort, because if you want or not logs are in cloud logging. Simply implement alerts and push logs to Splunk. Simples.

コメント 12Comment 12

Aが正しいです

A is correct

コメント 13Comment 13

それが一番正しい答えです。 C はエージェントなしでは機能せず、古い監視にログを送信するのは意味がありません。

It's the rightest answer. C cannot work without Agent and there's not sense to send log to old monitoring

コメント 14Comment 14

コンピューティング エンジンに Stackdriver エージェントをインストールしないと Stackdriver を使用できないためです。

It's A 'cos you cannot use Stackdriver if you don't install Stackdriver agent on your compute engine.

コメント 14.1Comment 14.1

こんにちは

ここから何か質問は見つかりましたか?

Hi

Did you find any questions from here?

コメント 15Comment 15

コミュニティの選択は C です

Community choice is C

コメント 16Comment 16

CよりAのほうがいいと思います

アプリは移行されていますが、直接接続などを使用して古いシステムを修正する代わりに、データを既存のシステムに送り返すために C に投資する理由はありませんか

I think it should be A than C

Apps have been migrated and why would you invest on C to send data back to existing system instead fix old system using direct connect or something

コメント 16.1Comment 16.1

Nvm C にするべきだと思います

Nvm I think it should be C

コメント 17Comment 17

答えは C です。ポイントは監視ではなく、パフォーマンスが低い通知の問題です。

The answer is C. The point is notification problem with low performance, not monitoring.

コメント 17.1Comment 17.1

C はなぜ Stackdriver エージェントなしで動作するのでしょうか?

Why can C work without stackdriver agent?